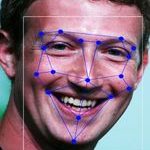

De commissaris voor mensenrechten bij de VN pleit voor een stopzetting op het gebruik van biometrische herkenning in de publieke ruimte, las ik bij Tweakers. Mevrouw Bachelet doet deze uitspraak in een rapport van de Verenigde Naties waarin de effecten van artificiële intelligentie op mensenrechten wordt besproken. Overheden zouden eerst moeten kunnen aantonen of er voldaan wordt aan de privacywetgeving en of er niet gediscrimineerd kan worden. En dat geeft weer gelijk discussie over de vraag of een AI wel kan discrimineren.

De commissaris voor mensenrechten bij de VN pleit voor een stopzetting op het gebruik van biometrische herkenning in de publieke ruimte, las ik bij Tweakers. Mevrouw Bachelet doet deze uitspraak in een rapport van de Verenigde Naties waarin de effecten van artificiële intelligentie op mensenrechten wordt besproken. Overheden zouden eerst moeten kunnen aantonen of er voldaan wordt aan de privacywetgeving en of er niet gediscrimineerd kan worden. En dat geeft weer gelijk discussie over de vraag of een AI wel kan discrimineren.

Het rapport stipt nog meer dingen aan, zoals dat AI vaak door private partijen wordt geleverd en dan totaal niet transparant is. Of dat je niet weet waar de data vandaan komt of wat men er nog meer mee doet. Ik vind dat soort dingen minstens zo ingewikkeld en juridisch vervelend.

Maar goed, discriminatie. Gewoon een neutraal woord in de wetenschap hoor, zo lees ik dan in de comments. En terecht: het betekent gewoon “onderscheid maken” en in de statistiek gebruik je dat voor iedere situatie waarin je data in groep A of B gaat onderverdelen. Maar juristen en ethici bedoelen er wat anders mee, namelijk het onderscheid maken op basis van verboden kenmerken zoals etnische afkomst, seksuele gerichtheid of politieke voorkeur. Dat willen we niet, en daar is een hele goede reden voor: deze kenmerken zijn fundamentele waarden van mensen, en ook niet te wijzigen zoals een kledingkeuze of zelfs woonplaats. Daar blijf je dus af.

Bovendien is er nooit enig oorzakelijk verband aangetoond tussen die kenmerken en welk gedrag dan ook. Iedere uitspraak van het soort “mensen met etnisch kenmerk X willen/hebben/kunnen/haten” is dus automatisch fout, dat is gewoon geen kenmerk waar je uitspraken op kunt baseren. Oké, heel misschien medische kenmerken (kroeshaar is lastiger te scheren, Aziaten verdragen koemelk niet) maar dat zijn echt de uitzonderingen. Het soort situatie waar we het bij AI vaak over hebben, past daar niet bij.

Dat wringt, omdat we vaak AI systemen correlaties zien aanwijzen: de criminaliteit is hoger bij groepen met etnisch kenmerk X, sollicitanten met huidskleur A zijn minder geschikt, seksuele gerichtheid X gaat niet samen met lesgeven op school. Voor een AI is dat inderdaad een neutrale constatering, als dat zo in de dataset zit en de functie komt daarbij op een goed werkend onderscheid (de test-dataset wordt correct als ja of nee gesorteerd) dan is het in orde.

Zo’n conclusie is voor de maatschappij echter niet in orde. In eerste instantie niet omdat de dataset waarschijnlijk niet compleet is (dit is namelijk bij vrijwel iedere AI applicatie een ware uitspraak). Maar zelfs als je wél alle relevante data hebt, blijft er een probleem.

Natuurlijk kan een AI ook een bestaande bias blootleggen. Huidskleur blijkt bij dit bedrijf een perfecte voorspeller van geschiktheid, omdat de HR-medewerker die de sollicitanten screende, zelf die bias had. Dan heb je dus een bias geformaliseerd, maar dat kun je het systeem niet verwijten toch? Die geeft neutraal aan hoe de werkelijkheid is, hoe de maatschappij er nu uit ziet.

Maar dat is niet waar. Een mens is allereerst niet zo hard als een AI. Die zal niet snel iemand in zijn of haar gezicht zeggen, je huidskleur past niet bij dit bedrijf. Die verzint excuses, blaast een smetje op het cv op of legt het gewoon op de stapel “tweede keus” wetende dat er al tien mensen op gesprek komen. Dat merk je niet. Een AI zegt gewoon letterlijk waar het op staat, zonder schroom of vergoeilijking of excuses. En dat valt veel meer op, komt veel meer binnen.

Bovendien, en dat vind ik problematischer, heeft een AI veel meer een aura van objectiviteit, betrouwbaarheid, echtheid. De cijfers zeggen het, deze huidskleur kan gewoon niet bij dit bedrijf. Helaas, objectief berekend met 88% betrouwbaarheid en achttien cijfers achter de komma. Maar in feite hebben we hetzelfde als die HR-medewerker die het met mooie smoesjes wist te verhullen.

Arnoud

‘De commissaris voor mensenrechten bij de VN pleit voor een stopzetting op het gebruik van biometrische herkenning in de publieke ruimte’

Dat is natuurlijk heel mooi, maar zolang de overheden van heel ruim meer dan de halve wereld de basismensenrechten keihard naast zich neerleggen, lijkt me dit een discussie over het geslacht van de engelen. Die commisaris heeft wel belangrijker dingen om voor te pleiten, lijkt me zo.

Aan de andere kant, voorkomen is beter dan genezen. Als je kijkt naar hoe China die systemen inzet voor sociale controle dan vind ik dat heel eng, en zelf een behoorlijke schending van mensenrechten. Dat er ook op veel plekken nog erger dingen gebeuren is zeker waar, maar het een sluit het ander niet uit; het is niet zo dat die commissaris zich uitsluitend met de allerergste schending mag bezighouden en pas tegen wat anders mag gaan waarschuwen als die allerergste schending is opgelost.

Klopt natuurlijk, maar als China zich al niets aantrekt van vrije verkiezingen, rechten voor minderheden, doodstraf, vrije pers etc, denk je dan dat ze ineens biometrische herkenning een big issue gaan vinden?

Nee natuurlijk niet, China trekt zich van al dat soort dingen niets aan, helaas. Maar goed, daarom moet je als VN commissaris er nog wel voor pleiten. Als we stoppen met kritiek hebben op landen die zich niets van die kritiek aantrekken dan is dat toch een soort impliciete goedkeuring of acceptatie.

AI heeft altijd last van bias. Het is ingeprogrammeerd. Iedereen heeft bias, goed of slecht, en als een persoon vervolgens een algoritme gaat verzinnen waarmee een AI dingen gaat bekijken, zit er bedoeld of onbedoeld een bias ingebouwd die vroeger of later de resultaten gaat beinvloeden.

Daarnaast heb je het over de ethische vraagstukken. Dat is tricky. We zijn tegenwoordig dusdanig alergisch over racisme dat we zaken soms te ver door trekken. De politie kan heel goed vaststellen zonder te discrimineren dat op een bepaalde plaats en tijd er veel overlast is van een bepaalde bevolkingsgroep die dan bepaalde dingen uitvreet. Maar het mag hier dan niet specifiek op controleren, want profiling, dus discriminatie. Dat is de omgekeerde wereld en net zo fout als doelbewust bepaalde groepen targeten zonder dat hier een aanwijsbare reden voor is, == discriminatie.

Maar zolang we niet eerlijk tegen elkaar kunnen zijn en zaken als racisme benoemen als dat nodig is, maar het ook durven benoemen als het misbruikt dreigt te worden, dan zullen we bias in AI nooit kunnen uitsluiten omdat er in de huidige status quo geen discussie te voeren valt over wat wel en niet kan. Want laten we wel onthouden, bias is bias, ongeacht welke kant op en het is altijd slecht en ten nadele van echte mensen als we daardoor onterechte beslissingen nemen of laten nemen.

Help me even, hoe is “een bepaalde bevolkingsgroep geeft overlast” op welke wijze dan ook een NIET discriminerende kwalificatie? Die overlast zit toch niet in de genetische profielen van de mensen uit die groep?

Het probleem met profileren is dat het werkt, in de zin dat je dan mensen uit je gekozen groep vindt die het onrechtmatig gedrag vertonen. Dat bewijst dan dat het profileren klopt: zie je wel, altijd weer die Zweden die op straat overlast geven. Daarnet nog drie Zweden gevolgd en eentje stond inderdaad hinderlijk te roken. Maar heb je nu werkelijk de overlast de kop ingedrukt, wat doe je met overlastgevende Monegasken die buiten je profiel vallen? Die krijgen meestal geen prioriteit want het profiel focust op Zweden.

Dit nog los van het simpele mathematische feit dat zelfs als 90% van de overlast van Zweden afkomstig is, dat nog niets zegt over hoe veel Zweden overlast geven.

Inderdaad, het is nooit een bepaalde bevolkingsgroep die overlast geeft, het zijn individuen die overlast geven, en daar persoonlijk voor aangesproken moeten worden. Niet willekeurig andere mensen die toevalig ook tot die bevolkinsgroep horen, en geen overlast geven. Stel jij bent autochtoon Nederlander, dan ben jij toch ook niet verantwoordelijk voor het Nederlandse slavernijverleden, en wil je daar toch ook niet over worden aangesproken?

Natuurlijk kan het zo zijn dat in bepaalde bevolkingsgroepen meer individuen zijn die overlast geven. Dat heeft dan vaak te maken met economische en soms culturele aspecten — en regelmatig ook juist met discriminerend gedrag in het verleden, waardoor die individuen in zo’n nadelige positie zijn gekomen.

En, over overlast gesproken: als een groepje autotochtone ouderen op het plaatselijke leugenbankje samen zitten te praten en roken, wordt daar in de praktijk veel minder over geklaagd, dan als een groepje jongeren “van Noord-Afrikaanse afkomst” dat hetzelfde gedrag vertoont, terwijl objectief gezien, het gedrag hetzelfde is.

Dus “De Hell’s Angels geven overlast” is ook een discriminerende kwalificatie volgens jou? Dat is an sich best te beargumenteren, maar dat wordt dan erg moeilijk verenigen met ‘alle discriminerende kwalificaties zijn bij voorbaat slecht’.

Nee. Van de HA of een andere vereniging word je lid, dat is een keuze. Daarop aangesproken worden is verdedigbaar, zeker als het gaat om gedrag dat samenhangt met het doel van de vereniging. Als ik lid word van een schietclub, is het normaal dat de politie af en toe onverwacht aanbelt om mijn wapenkluis te controleren.

Etnische kenmerken daar word je mee geboren en die zeggen niets over je gedrag. Etnische groepen hebben geen doelstellingen, geen strevens en geen predisposities naar bepaald gedrag. Het is fundamenteel oneerlijk om daarop aangesproken te worden. “Oh kijk, weer zo’n krullenbol, nee die zijn niet serieus en kunnen geen directeur worden” is een idiote opmerking. “Ah ja twee Finnen op een scooter die zullen wel iets crimineels gaan doen, even preventief fouilleren” is daarentegen een normale vorm van politie-profileren?

Ah oke, dus je beperkt de term ‘bevolkingsgroep’ hier tot etniciteit. Dan ben ik het er zeker mee eens, maar dat was me niet duidelijk, voor mij kan een bevolkingsgroep uit veel meer kenmerken bestaan dan alleen diegenen waarmee iemand is geboren.

Religie is bijvoorbeeld ook een beschermd kenmerk, maar religie zegt juist heel veel over iemands gedrag, heeft wel doelstellingen, strevens, soms zelfs sterke politieke doelen, etc. Veel mensen zijn geen lid van een bepaalde religieuze groep omdat ze daarvoor hebben gekozen. Ze hebben echter wel de keuze om uit die religie te stappen (even daargelaten dat daar in bepaalde religies de doodstraf op staat).

En ander voorbeeld, wat als er een sterke correlatie is (correlatie is geen causatie) tussen huidskleur en lid zijn van zulke clubs? Ben je dan aan het discrimineren als je die clubs/gangs aanpakt?

Sorry, dat is voor mij hetzelfde. Anders krijg je vrij arbitraire afbakeningen of heel abstracte begrippen zoals ‘stedelingen’ of “mensen die vaak in hipstertentjes rondhangen”. Daar gaat de wet niet over, die beschermt etnische afkomst, raciale kenmerken et cetera maar niet je haarkeuze, in kraakpanden wonen of je keuze voor een landelijke woning versus een centrumappartement.

Religie is inderdaad iets waar je (vaak theoretisch) een keuze voor maakt. De reden dat die er tussen staat is vooral omdat mensen religie als zéér belangrijk in hun leven ervaren. Maar ik denk dat het eerder te rechtvaardigen is om te zeggen “die wederdopers willen een theocratie, laten we ze extra in de gaten houden” dan “Westfriezen zijn zuiplappen dus extra alcoholcontroles in die regio”.

Ik denk dat mijn weerstand in eerste instantie is: correlatie is geen causatie, dus je maakt je er te makkelijk vanaf. Zoek eerst de oorzaak en ga vanuit daar handelen. Maar ondertussen wordt voor mij belangrijker dat als je op basis van een correlatie gaat handelen, je snel je gedrag bevestigt ziet en dan toch gaat denken dat dit de causatie is. Zie de zelfversterkende feedbackloop van Ionica Smeets.

Helelmaal mee eens, maar omgekeerde discriminatie mag wel? Een tijd geleden de politie gebeld omdat leden van een bepaalde bevolkingsgroep tijdens een bruiloft de rijbaan blokkeerden en met veel claxonneren hun weg vervolgden in een woonwijk. Reactie was, dat dit normaal is bij bruiloften van die groep. Toch vreemd, want wanneer dat bij mijn familie gedaan wordt, komen ze i.v.m. geluidsoverlast. Dat lijkt mij toch ook niet de bedoeling, want het voelt behoorlijk frustrerend.

Wel, dat is ook een beetje mijn gevoel:

Bepaalde groepen/culturen/ethniciteiten willen wel graag een bijzondere behandeling als het hen uitkomt (tja, zo doen wij dat nu eenmaal bij ons, zeggen ze dan), maar roepen discriminatie als een bijzondere behandeling hen niet uitkomt. En dat wringt.

Dat is van twee walletjes eten.

Religie is in zekere zin een club, waar je lid van kan worden, en waar je dus ook afscheid van kunt nemen als de doelstellingen van die club je niet meer aanstaan — alleen overstijgt zoiets vaak het idee van een club: je heb vele clubs met hun eigen interpretatie van Christendom of Islam, etc., die allemaal onder die respectievelijke paraplu vallen, maar elkaar soms aardig naar het leven kunnen staan, maar waar ook je hele sociale netwerk en wereldbeeld mee verweven is. Ik heb zelf trouwens eerder de voorkeur om in opsommingen het te hebben over “religeuze achtergrond” om dat aspect te benadrukken. (Hoe leden van bv de RK kerk zich dienen te gedragen, gezien de historisch volslagen onvoldoende maatregelen tegen kindermisbruik, is weer een volgend dillema: ik neig er toe om te pleiten dat het net als de Hells Angels tot een verboden organisatie wordt verklaart, als er niet snel veel radicaler wordt ingegrepen, maar veel individuele leden hebben hier niets mee te maken of zijn zelfs slachtoffer.)

Mijn definitie van discriminatie is trouwens het onderscheid maken op niet-relevante kenmerken. Jouw huidskleur is totaal niet relevant als het gaat om de vraag hoe goed jij een jurist of programmeur kunt zijn, maar wel als jij een stuk kleding uitzoekt of de rol van Nelson Mandela in een film wilt spelen. Etniciteit kan een rol spelen in bepaalde medische contexten — maar daar moet je dan weer snel overheen stappen als de juiste diagnose is gesteld.

Dat is een heel goed punt, zo had ik er nog niet over gedacht.

Mja. Ik word alleen zo moe van die figuren die dan altijd maar die oorzaak gaan zoeken in de witte-onderdrukking-uit-het-verleden.

Hoi Arnoud,

Volgens jou zouden juristen met discriminatie bedoelen het onderscheid maken op basis van verboden kenmerken zoals etnische afkomst, seksuele gerichtheid of politieke voorkeur. Waarom mag je dan niet discrmineren op welke grond dan ook?

De rechter heeft geoordeeld dat het controleren (mede) op basis van de etniciteit door de marechaussee geen discriminatie is. Het idee dat discriminatie onderscheid maken is op basis van verboden kenmerken, zoals in dit artikel gesteld wordt, is dan ook onjuist. https://nos.nl/l/2398786

Dit vraagt om een ECLI-link!

Ik moet toegeven dat ik de argumentatie in het vonnis niet overtuigend vind en dat wat mij betreft de uitkomst ook in het voordeel van de eisers had kunnen uitvallen.

De kern staat in 8.9:

Vertaling: de Marechaussee wil illegale vreemdelingen vinden om ze tegen te houden. Daartoe kijkt ze naar etnische uiterlijke kenmerken, met het idee dat je vaker vreemdelingen zult krijgen die geen standaard Nederlands uiterlijk heeft. Dus bij die situatie is kijken naar huidskleur of type haar een logisch en objectief begrijpelijk handelen, en daarmee geen discriminatie.Ik zie een spanning tussen artikelen 1 en 2 van de grondwet; Artikel 1 verbiedt discriminatie (o.a op grond van ras), maar artikel 2 wettigt discriminatie op grond van nationaliteit. In gevallen waar ras/huidskleur gebruikt wordt als proxy voor nationaliteit geef ik prioriteit aan artikel 1, maar ik begrijp de grondwettelijke spagaat die de rechter moet maken.

Ik wil mezelf even verduidelijken:

Als ik vanuit het oogpunt van een willekeurige vliegtuigpassagier kijk en zie dat stelselmatig 50% van de donkere medelanders bij de MTV controles uit de rij gepikt worden tegenover 5% van de blanke medelanders dan zie ik dat er onderscheid gemaakt wordt op basis van ras. De staat erkent dat individuele marechaussees dat kunnen doen en roept “risicoanalyse”. In hoeverre mag een “risicoanalyse” de grondwet terzijde schuiven?Het is dun, maar het argument is dus dat de Marechaussee niet selecteert op etnisch kenmerk maar op een risico-inschatting van nationaliteit, waarbij het etnisch kenmerk een indicatie van nationaliteit is. De juridische constructie is dat onderscheid op een objectief gerechtvaardigd kenmerk geen discriminatie is. Zeg maar net zoals “we zoeken een oude witte man met diepe stem” een toegestaan criterium is voor een acteur die Sinterklaas moet spelen.

Dan nog: als een witte Braziliaan niet uit de rij gehaald word en een zwarte Braziliaan wel, is het nog steeds discriminatie.

Het idee dat een etnisch kenmerk een indicatie is van nationaliteit is flinterdun. Een donker persoon op de Thalys uit Parijs heeft veel waarschijnlijker de Franse nationaliteit dan van een land waarvan de inwoners niet zomaar Nederland inmogen.

De rechter heeft geoordeeld dat het controleren (mede) op basis van de etniciteit door de marechaussee geen discriminatie is. Het idee dat discriminatie onderscheid maken is op basis van verboden kenmerken, zoals in dit artikel gesteld wordt, is dan ook onjuist. https://nos.nl/l/2398786

Hoe kan benoemen van feiten een discriminerende kwalificatie zijn? Van alle geregistreerde verdachten van een misdrijf in 2017, was 4,4% Antilliaans, 3,7% Marokkaans, 2,8%, Surinaams, 2,0% Turks, 1,9% overige niet-westerse mensen, en 0,7% Nederlands. Waarom zou dat niet gezegd mogen worden?

Van alle geregistreerde verdachten… [citation needed]

De getallen tellen niet op tot 100%, hoeveel staat op “onbekend” of “niet geregistreerd”?

Is het nodig de afkomst van een verdachte te registreren of is observeren met welke andere personen de verdachte contact heeft (ongeacht ethniciteit) een betere manier om criminele netwerken in kaart te brengen?

Je zegt hier niets dat aanleiding geeft tot de conclusie “een bepaalde bevolkingsgroep geeft overlast”. Je zegt “een percentage van de overlastgevers komt uit een bepaalde bevolkingsgroep”. Die twee dingen hebben niets met elkaar te maken.

Stel er zijn honderd mensen op een feest, waarvan twintig Antilliaan. Twee mensen geven overlast: een Nederlander en een Antilliaan. Het is dan feitelijk juist dat 50% van de overlastgevers Antilliaan is, maar ik hoop dat niemand dan denkt dat die twintig mensen maar even extra gecontroleerd (of apart gezet, of naar huis gestuurd) moeten worden.

Dan ga je er van uit dat de politie naar huidskleur en haar kijkt om te betalen wie ze aanhouden. Is het niet realistischer dat de politie kijk naar zaken als kleding, houding, gedrag en dergelijke. Als je je kleedt alsof je “gangsta” bent dan is het toch niet vreemd als de samenleving je ook zo gaat behandelen, ongeacht welke huidskleur er onder die kleding zit.

Twee woorden: “Cultural Appropriation”.

Kledingstijl heeft veelal ook een relatie met een bepaalde cultuur. De “gangsta” stijl is gebaseerd op een combinatie van hiphop muziek en rap muziek en behoort veelal bij de Amerikaanse getto-cultuur en dan vooral onder kleurlingen. Sowieso wordt de gehele hiphop cultuur vooral door Afro-Amerikanen overheerst. Als jij dan als blanke Hollander dan “gangsta” gaat kleden dan vraag je eigenlijk al om problemen. Maar gelukkig zijn er kledingstijlen die wel meer bij een blankere huidskleur passen. Minimale verschillen, dat wel. Maar een AI kan deze er makkelijk uitpikken en het verschil tussen “gangsta” en “Nederhop” gewoon herkennen aan de kledingstijl en dus weer aan de cultuur en huidskleur.

Maar goed, zelfs iets simpels als schoeisel bepaalt mee aan je culturele uitstraling en ook hier is de keuze voor een bepaald type schoen deels cultureel bepaald. Niet dat er veel Hollanders op klompen lopen, geitenwollen sokken met sandalen roepen sowieso al een soort beeld op van het type persoon dat dit zal dragen.

Een probleem bij AI en biometrische herkenning is de discriminatie, zeker als het om gezichtsherkenning gaat. Want het probleem is dat men afhankelijk is van licht om een gezicht te herkennen en dan vooral het contrast door schaduwen en highlights. Bij een lichte huidskleur heb je veelal een eenvoudiger beeld om te herkennen dan bij een donkere huidskleur met exact dezelfde verlichting. Dat komt omdat donkere schaduws op een donkere huid gewoon niet zichtbaar zijn en een schaduw niet lichter dan de huid kan zijn. Bij donkere mensen ben je dan ook meer afhankelijk van highlights en dus een goede lichtbron.

Op Wired was in 2019 her artikel The Best Algorithms Struggle to Recognize Black Faces Equally dat het probleem gewoon onderschrijft. Mensen met een donkere huid hebben een veel grotere kans op een mismatch waardoor ze niet herkend worden of waarbij het systeem hun identiteit met iemand anders verwart.

En Harvard heeft het in 2020 over Racial Discrimination in Face Recognition Technology waarmee het probleem van discriminatie door AI nog duidelijker wordt gemaakt.

Maar goed, ook op andere punten kun je veel makkelijker discrimineren met een AI omdat een AI sneller verbanden kan leggen tussen menselijke kenmerken en gewenste eigenschappen. En dat komt omdat de AI gewoon naar harde cijfers komen die door onderzoek verzameld moeten worden. Cijfers over autisme, bijvoorbeeld. Mensen met autisme hebben beperkingen in sociale communicatie dus als je een woordvoerder nodig hebt of een andere medewerker die zich in communicatie specialiseert dan zoek je liever een vrouw, omdat autisme onder mannen drie maal vaker voorkomt. En zo zijn er veel andere wetenschappelijke feiten die vertaald kunnen worden naar cijfers die een AI kan verwerken of die door een AI herkend kunnen worden.

Zo zou je mogelijk ook een verband kunnen vinden tussen het merk auto dat iemand koopt en de kans dat die persoon vervolgens verkeersboetes krijgt of een ongeluk kan krijgen gebaseerd op statistieken die uitzoeken welke merken het hoogst scoren in die groepen. Of welk automerk het meest gestolen wordt. En dat betekent dat verzekeringspremies gekoppeld zouden kunnen worden aan automerken en je zo een andere vorm van discriminatie krijgt. Dan betaal ik minder premie voor mijn Mitsubishi dan Arnoud voor zijn BMW… 🙂

Maar goed, AI is gemaakt om patronen te herkennen en dan op basis van die patronen de meest ideale keuzes te maken. Op zich is daar niets mis mee, behalve dan dat wij mensen vinden dat wij allemaal gelijkwaardig zijn. Dat de AI gewoon kijkt naar de waarheid en dar de waarheid gewoon is dat we allemaal verschillen hebben we hier dus grote problemen mee. Mede ook omdat de beslissingen van de AI grote gevolgen kan hebben voor onze loopbaan en onze levens.

Helaas is discriminatie niet altijd te voorkomen. Zeker in de wereld van fotografie is discriminatie nu eenmaal onvermijdelijk omdat een donkere huidskleur veel lastiger te fotograferen is. En men veelal ook zoekt naar aantrekkelijke modellen en niet de ongeschoren kop die ik heb. 🙂 Maar goed, als je een taxi-chauffeur zoekt dan wil je geen blinde chauffeur. En een straatagent in rolstoel is ook erg onhandig. Maar ook een winkelbediende zonder armen kan problemen opleveren, hoewel dat niet onmogelijk is. We zijn nu eenmaal allemaal verschillend, ook al willen we dat niet erkennen… Dus discriminatie is eigenlijk niet zo makkelijk op te lossen door te beweren dat we allemaal gelijk behandeld moeten worden. Dat werkt gewoon niet!

Maar op bepaalde punten kunnen we wel iedereen gelijktrekken naar hetzelfde niveau, door b.v. iedereen gelijke opleidingskansen te bieden. Iedereen recht geven op een goede basisopleiding en ook zorgen dat hun ouders hieraan meewerken en niet gaan dwarsliggen als bepaalde onderwerpen als lesstof worden gebruikt. Maar goed, ook dat ligt weer erg gevoelig…