Het lijkt erop dat degene die op 5 augustus 2017 om 2.31 uur bij de geldautomaat is gefilmd, ook in de politiedatabase staat: Thomas. Zo introduceert Nu.nl een strafzaak waarin gezichtsherkenning door het politiesysteem CATCH centraal stond in het bewijs. Nadat ook twee onderzoekers de gezichten met elkaar vergelijken, concludeert het Centrum voor Biometrie namelijk dat Thomas veel overeenkomsten en geen significante verschillen vertoont met de persoon die om half drie ’s nachts pint. Hebbes, zegt de statistiek. Nope, zegt de rechtbank Den Bosch.

Het lijkt erop dat degene die op 5 augustus 2017 om 2.31 uur bij de geldautomaat is gefilmd, ook in de politiedatabase staat: Thomas. Zo introduceert Nu.nl een strafzaak waarin gezichtsherkenning door het politiesysteem CATCH centraal stond in het bewijs. Nadat ook twee onderzoekers de gezichten met elkaar vergelijken, concludeert het Centrum voor Biometrie namelijk dat Thomas veel overeenkomsten en geen significante verschillen vertoont met de persoon die om half drie ’s nachts pint. Hebbes, zegt de statistiek. Nope, zegt de rechtbank Den Bosch.

De strafzaak (vonnis) gaat over een hele trits feiten, niet alleen een keer pinnen met andermans pinpas, maar ook witwassen en lidmaatschap van een criminele organisatie. De rechtszaak is namelijk onderdeel van een groter onderzoek naar een bende die bankrekeningen plundert. En kennelijk is ‘Thomas’ (de naam is nep) de leider van dat netwerk want hij heeft statistisch gezien gepind met een gestolen pas?

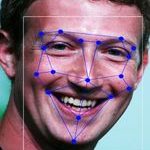

Herkennen van mensen van foto’s is natuurlijk altijd lastig. Maar hier werd niet door menselijke getuigen of rechercheurs gekeken; het gaat om een automatisch gezichtsherkenningssysteem dat CATCH heet. De cijfers zijn schokkend: jaarlijks gaan zo’n duizend foto’s van verdachten door de database met 1.3 miljoen mensen. En dat levert dan 98 keer een match op. Nee, niet 980 of 98%, acht-en-negentig. Net geen honderd. Ja, ik val ook van mijn stoel.

Waarschijnlijk komt dat lage aantal omdat de meeste beveiligingscamera’s de kwaliteit van een aardappel hebben, als ik de beelden van Opsporing Verzocht mag geloven. Plus, veel criminelen weten natuurlijk dat ze hun gezicht moeten bedekken om niet te makkelijk herkend te worden. En men zal vast ook alleen een match willen geven als het systeem het heel zeker weet.

Maar hoe zeker is zeker? Dat weten we niet, en dat is ook fundamenteel lastig. Al is het maar vanwege de vraag of de werkelijke dader wel in het systeem zit. Anders krijg je gewoon “de best matchende persoon is deze” en als dat ook een hoog percentage betrouwbaarheid geeft, dan is de conclusie “dit is hem” snel gelegd. Natuurlijk kijken er dan nog mensen naar, maar “even checken, dit is hem toch” is heel wat anders dan “hier zijn duizend gezichten, welke is het”.

De rechtbank is er dan ook héél snel klaar mee:

De rechtbank is van oordeel dat in dit geval de ‘hit’ op verdachte in het zgn. CATCH-systeem (Centrale Automatische Technologie voor herkenning) onvoldoende is om te concluderen dat verdachte – buiten redelijke twijfel – als pinner kan worden aangemerkt. De opmerking dat twee onderzoekers zagen dat er veel overeenkomsten waren en geen significante afwijkingen, acht de rechtbank niet zodanig overtuigend dat de ‘hit’ als basis voor een bewezenverklaring kan dienen. Nu er buiten de herkenning geen andere bewijsmiddelen voorhanden zijn die verdachte verbinden aan een van de ten laste gelegde feiten, is de rechtbank van oordeel dat verdachte dient te worden vrijgesproken.

Bij een strafzaak moet het gaan om wettig en vooral overtuigend bewijs. Oftewel, geen redelijke twijfel. Enkel “hij lijkt best goed” is niet hetzelfde als “er is geen twijfel dat dit hem is”. Tussen de regels door lees ik dat de rechtbank alléén een fotoherkenning te weinig vindt. Had zijn telefoon even uitgepeild, een vingerafdruk genomen of iets anders dat hem op de plaats delict zet. Maar dit is echt te weinig.

Arnoud

Het gebruik van camera’s met gezichtsherkenning is,

Het gebruik van camera’s met gezichtsherkenning is,  Het hoeft niet, maar het kán: midden in de nacht fitnessen. Dat

Het hoeft niet, maar het kán: midden in de nacht fitnessen. Dat  De Autoriteit Persoonsgegevens gaat vragen stellen aan de NS over reclameschermen van ExterionMedia die camera’s bevatten,

De Autoriteit Persoonsgegevens gaat vragen stellen aan de NS over reclameschermen van ExterionMedia die camera’s bevatten,  Rusland is in de ban van FindFace, een app waarmee gebruikers anderen kunnen identificeren door een foto van ze te maken,

Rusland is in de ban van FindFace, een app waarmee gebruikers anderen kunnen identificeren door een foto van ze te maken,